Nel mio post precedente, Strumenti utili perché un non vedente possa utilizzare in autonomia un PC Windows, nella sezione dedicata agli Smart Glasses, ho analizzato e confrontato alcuni modelli di diverse marche, tenendo principalmente in considerazione le funzionalità utili per persone non vedenti. Infatti, si è visto come gli smart glasses possano avere impatti rilevanti sull’accessibilità per utenti non vedenti: tutti quanti si connettono tramite Bluetooth a dispositivi esterni (es. PC, smartphone).

- Categorie funzionali di Smart Glasses

- Perchè gli Smart Glasses utilizzano Meta AI?

- Ray-Ban Meta Gen 2

- Differenze principali tra Ray-Ban Meta di Generazione 1 e i nuovi di Generazione 2

- Comparazione tra diversi dispositivi che utilizzano la medesima app Meta AI – Vibes & AI Glasses

- Esperienza di una persona non vedente Wayfarer: “Gli occhiali che ci portano lontano” (Luglio 2025)

_____________________

Categorie funzionali di Smart Glasses

Gli Smart Glasses si dividono in tre categorie funzionali:

- Occhiali audio con fotocamera e AI multimodale: permettono descrizione della scena, riconoscimento oggetti e interazione vocale avanzata. Risultano i più utili in questo contesto.

- Occhiali audio senza fotocamera: utili per comandi vocali e ascolto, ma senza supporto visivo.

- Occhiali AR (Augmented Reality, realtà aumentata) con display: progettati per utenti vedenti o ipovedenti, poco utili per chi non vede. Usano tecnologie che sovrappongono informazioni digitali al mondo reale: non sostituiscono ciò che vedi, ma lo arricchiscono con elementi aggiuntivi (es. testi, immagini, indicazioni, oggetti virtuali, menu, mappe). Non forniscono quindi grande supporto a un non vedente, se non unicamente per le loro funzionalità audio.

_______________

Perchè gli Smart Glasses utilizzano Meta AI?

Sempre in quel mio post si era sottolineato come gli smart glasses che utilizzano una AI multimodale si appoggino a Meta AI e non altri sistemi AI come ChatGPT o Copilot. Il motivo è che Meta AI è integrato profondamente nell’ecosistema Meta (Facebook, Instagram, WhatsApp) e quindi offre un’esperienza fluida e contestuale per gli utenti che già utilizzano queste piattaforme. Questo permette un’interazione più naturale e integrata rispetto a sistemi esterni come ChatGPT o Copilot, che richiedono app o interfacce separate.

Inoltre, Meta AI è progettato specificamente per dispositivi indossabili come gli smart glasses come i Ray-Ban Meta, con ottimizzazioni per l’uso in mobilità, riconoscimento visivo in tempo reale e comandi vocali avanzati. Invece, ChatGPT e Copilot sono potenti AI generali, ma non sono ancora ottimizzati per l’integrazione hardware specifica degli smart glasses, né per l’ecosistema sociale e multimediale di Meta.

Andando nel dettaglio, l’AI basata sul modello linguistico Llama (usata da Meta nei Ray‑Ban Meta, Oakley Meta Vanguard, Meta Display e nell’app Meta AI) si distingue da ChatGPT e da Copilot per tre aspetti fondamentali: modello, filosofia, integrazione nei dispositivi. Le differenze emergono chiaramente confrontando come ciascuna tecnologia è progettata e utilizzata.

🧠 Modello linguistico: Llama vs ChatGPT vs Copilot

Llama (Meta)

- È un modello open‑weight, cioè scaricabile e utilizzabile anche localmente da aziende e sviluppatori.

- È progettato per essere leggero, efficiente e integrabile in dispositivi come occhiali smart e wearable.

- È molto personalizzabile e permette maggiore controllo e privacy per chi lo implementa.

- È ottimizzato per multimodalità in tempo reale: riconoscimento visivo, descrizione scene, traduzione live.

- Questo è il motivo per cui funziona così bene sugli occhiali Meta.

- Le fonti lo descrivono come il principale modello open‑source ad alte prestazioni, scelto da aziende che vogliono autonomia e personalizzazione .

ChatGPT (OpenAI)

- È un modello chiuso, centralizzato e molto più grande.

- È ottimizzato per:

- ragionamento complesso,

- scrittura creativa,

- programmazione,

- conversazioni lunghe e coerenti.

- È considerato il modello “più completo” per versatilità e qualità generale del linguaggio .

- Non è progettato per funzionare direttamente su dispositivi indossabili: richiede cloud e potenza elevata.

Copilot (Microsoft)

- Non è un modello autonomo: è un servizio che usa modelli OpenAI (GPT‑4, GPT‑4.1, GPT‑4o) integrati con servizi Microsoft.

- È ottimizzato per:

- produttività (Word, Excel, Outlook),

- ricerca,

- automazione di attività,

- contesto locale del PC.

- È meno orientato alla multimodalità “nel mondo reale” rispetto a Meta AI.

🔍 Filosofia e obiettivi dei tre sistemi

Meta AI (Llama)

- Obiettivo: AI integrata nella vita reale, sempre attiva, multimodale, capace di vedere e descrivere ciò che l’utente vede.

- Pensata per wearable, occhiali, dispositivi mobili.

- Forte orientamento alla velocità e alla reazione immediata.

ChatGPT

- Obiettivo: massima capacità linguistica e cognitiva.

- È un assistente generalista, molto potente, ma non integrato nativamente in dispositivi fisici.

Copilot

- Obiettivo: produttività e integrazione con l’ecosistema Microsoft.

- È il migliore per documenti, email, fogli di calcolo, organizzazione.

🕶️ Integrazione nei dispositivi: il punto dove Llama è unico

Llama è l’unico dei tre modelli progettato per funzionare direttamente dentro occhiali smart e wearable, grazie a:

- efficienza,

- dimensioni ridotte,

- capacità di elaborare immagini e video in tempo reale,

- risposta immediata a comandi vocali.

Questo è il motivo per cui i Ray‑Ban Meta Gen 2 possono:

- descrivere ciò che hai davanti,

- leggere testi,

- riconoscere oggetti,

- tradurre in tempo reale,

- rispondere a domande contestuali.

ChatGPT e Copilot non possono farlo nativamente.

Tabella comparativa

| Aspetto | Llama (Meta AI) | ChatGPT | Copilot |

| Tipo di modello | Open-weight | Modello chiuso | Servizio basato su GPT |

| Punti di forza | Multimodalità reale, velocità | Ragionamento, creatività | Produttività, integrazione Microsoft |

| Dove funziona meglio | Occhiali, wearable | Browser, app | PC, Office, Windows |

| Personalizzazione | Alta | Bassa | Media |

| Obiettivo | AI nel mondo reale | AI generalista | AI per lavoro |

🎯 Sintesi finale

- Meta AI (Llama) è la migliore per dispositivi indossabili e per interagire con il mondo reale.

- ChatGPT è il più forte nella comprensione e generazione di linguaggio complesso.

- Copilot è il più utile per lavorare, scrivere documenti, organizzare attività.

___________

Ray-Ban Meta Gen 2

Dall’analisi fatta in quel post, si è visto che soprattutto quelli della prima categoria, occhiali audio con fotocamera e AI multimodale, sono di particolare interesse per una persona non vedente, permettendo una descrizione della scena, il riconoscimento di oggetti e una interazione vocale avanzata. In particolar modo i modelli Ray-Ban Meta Gen 2 attualmente sembra risultino quelli più avanzati: non per nulla la Ray-Ban ha ultimamente presentato (26/2/2026) questo suo prodotto all’Unione Ciechi di Torino.

In questo post intendo quindi fornire alcune informazioni in più sulla base della mia seppur limitata esperienza personale. Infatti, questa mattina ero nel centro della mia città, Torino, e ho notato in piazza Castello angolo via Roma il negozio dei Ray-Ban in cui erano esposti anche proprio quei modelli Meta e si potevano anche provare! Per di più quel negozio ha l’ingresso sempre aperto per invogliare potenziali clienti a visitarlo, per cui sono non ho esitato a entrare per chiedere informazioni e provarli. 😊

Ovviamente risultano acquistabili anche online, ad esempio su Amazon.

Nel seguito le informazioni ottenute e alcune mie considerazioni soggettive.

Innanzitutto, esistono tre modelli che differiscono unicamente da un punto di vista estetico e leggermente per il prezzo: in genere ci sono in nero lucido e nero opaco (l’opaco è un po’ più costoso) ma alcuni modelli hanno la montatura anche altri colori (e.g. bianco, viola) oltre a possibili colori delle lenti.

1) Wayfarer Gen 2

– Modello iconico Ray-Ban.

– Disponibile in due misure: 50 e 53.

– Fit a ponte alto: una buona scelta se il ponte del naso è al di sopra del livello delle pupille.

2) Headliner Gen 2

– Forma moderna e leggermente più avvolgente.

– Disponibile in una sola misura.

– Fit a ponte basso: una buona scelta se gli occhiali tendono a scivolare lungo il naso, a rimanere troppo in basso o a premere sulle tempie o sulle guance.

3) Skyler Gen 2.

– Modello più leggero e sottile, stile cat-eye morbido.

– Disponibile in una sola misura.

– Fit a ponte alto: una buona scelta se il ponte del naso è al di sopra del livello delle pupille.

Li ho provati tutti e solo la misura 53 del primo modello lo sentivo bene, mentre gli altri due, di misura unica standard, li sentivo stretti alle tempie.

Tabella comparativa tra i tre modelli

| Modello | Misure | Stile | Note | |

| Wayfarer Gen 2 | 50, 53 | Classico | Modello iconico, due misure | |

| Headliner Gen 2 | Standard | Moderno | Più avvolgente | |

| Skyler Gen 2 | Standard | Cat-eye morbido | Più leggero e sottile |

Quei tre modelli disponibili sono tutti analoghi da un punto di vista delle funzionalità e anche esteticamente sono abbastanza simili, anche se uno viene indicato con fit a ponte alto mentre gli altri due a ponte basso.

Personalmente li ho trovati un po’ massicci, stanghette larghe e spesse (sebbene sia giustificato dal fatto che contengono un bel po’ di elettronica) ma nel complesso abbastanza leggeri e comodi. Ho visto comunque anche altri modelli “normali” di occhiali Ray-Ban esteticamente non differiscono di molto da questi Meta AI.

Tutti i tre modelli hanno una custodia con integrato un powerbank che consente di ricaricare gli occhiali quando sono riposti. Anche le funzionalità AI integrate sono le medesime:

– Comandi vocali: attivazione tramite “Hey Meta” per scattare foto, registrare video, chiedere informazioni.

– Traduzione in tempo reale: ascolto e traduzione simultanea in 4 lingue (italiano, inglese, francese, spagnolo)… ed altre probabilmente a breve.

– Riconoscimento visivo: identificazione di oggetti, luoghi, testi tramite la fotocamera e Meta AI.

– Foto e video: fotocamera da 12 MP, video in 1080p, con archiviazione automatica.

– Assistente Meta AI: risposte intelligenti, suggerimenti contestuali, interazione naturale.

Sulla stanghetta destra, scorrendo lateralmente con il dito, si può assai agevolmente alzare/abbassare il volume. Mettendolo al massimo, l’ascolto dei messaggi e della musica risulta buono anche se pensavo meglio: un eventuale rumore esterno può interferire e almeno l’ascolto della musica non è confrontabile con quella che si ha utilizzando auricolari/cuffie, soprattutto relativamente alle frequenze basse… ma d’altra parte sono occhiali e forse è un bene che non interferiscano troppo con i rumori esterni per motivi di sicurezza. Sicuramente in un contesto silenzioso l’audio l’avrei potuto apprezzare meglio, ma chi ha problemi d’udito probabilmente troverà il volume troppo basso, seppure se posizionato al massimo.

Sempre sulla stanghetta sinistra, in alto e all’inizio, c’è un piccolo pulsante lungo (quasi invisibile) che, se premuto una volta scatta una foto, utilizzando le due telecamere (ben mimetizzate) posizionate simmetricamente sulle estremità in alto della montatura: l’immagine scattata viene automaticamente trasferta allo smartphone/tablet collegato agli occhiali via Bluetooth. Tenendo invece premuto per qualche istante quel medesimo pulsante, viene attivata una registrazione video che si interromperà ripremendo quel medesimo pulsante o dopo il periodo massimo di registrazione che attualmente è 3 minuti: questo limite è stato introdotto con l’aggiornamento che ha portato la registrazione in 3K, triplicando il precedente limite di 1 minuto. Il comportamento di questo unico pulsante è comunque configurabile da app o da altri fattori (versione del firmware degli occhiali ed eventuali aggiornamenti che hanno modificato i gesti, impostazioni nell’app Meta AI, modalità attiva).

In genere si usa questa logica:

- Pressione breve → scatta una foto

- Doppia pressione → avvia/ferma un video

- Pressione lunga → può avviare un video oppure attivare Meta AI, a seconda delle impostazioni. Meta ha infatti introdotto un’impostazione chiamata “Press and hold action” che può essere Start video o Activate Meta AI.

Per verificare e cambiare eventualmente il comportamento del tasto:

Apri l’app Meta AI → vai nelle impostazioni degli occhiali → cerca la voce Button & Gestures / Press and Hold / Long Press Action: quella impostazione consente di scegliere se la pressione lunga deve avviare un video o attivare Meta AI.

In pratica non è possibile registrare clip video più lunghi di 3 minuti in un’unica ripresa: la qualità 3K, cioè la risoluzione più alta attuale, ha aumentato la qualità ma anche il peso dei file. Questo limite garantisce che i file siano facilmente condivisibili, evitano un surriscaldamento della montatura, mantengono la qualità stabile e preservano la batteria. La Gen 2 ha comunque una autonomia migliorata avendo una batteria più capiente e quindi si possono registrare più clip prima di dover ricaricare.

L’app da installare sullo smartphone/tablet è Meta Meta AI – Vibes & AI Glasses che permette di

- Associare gli occhiali al telefono

- Importare foto e video

- Aggiornare firmware e impostazioni

- Usare le funzioni AI integrate negli occhiali

- Gestire privacy, comandi e backup

In pratica quella è l’unica app necessaria per usare i Ray‑Ban Meta Gen 2 su Android (è l’evoluzione della precedente app Meta View).

Ho provato anche a chiedere qualcosa a Meta tramite comandi vocali. Basta dire “Hey Meta…” (equivalente di “Hey Siri” o “Hey Google”) e, dopo questo richiamo, si può fare qualsiasi domanda _(e.g. “Che ore sono?”; “Scatta una foto”; “Che cosa sto guardando?”; “Traduci questo testo”; “Registra un video”). Gli occhiali rispondono tramite gli altoparlanti integrati.

Se si preferisce non usare il richiamo vocale, per attivare Meta AI senza voce, si può usare il tasto fisico sul lato destro della montatura che può essere configurato per aprire il canale con Meta AI per parlarle subito. Le funzioni disponibili che si possono chiedere includono:

- Informazioni generali (meteo, curiosità, calcoli, definizioni)

- Comandi per foto e video

- Traduzione in tempo reale

- Riconoscimento visivo (oggetti, testi, luoghi)

- Messaggi e interazioni social (dove supportato).

Sicuramente rilevante, soprattutto per un non vedente, è la funzionalità di riconoscimento visivo (oggetti, testi, luoghi). Chiedendo infatti ” Hey Meta, che cosa sto vedendo?“, viene automaticamente scattata una foto che viene analizzata dal SW di Intelligenza Artificiale per fornire vocalmente una risposta vocale che descrive effettivamente ciò che si ha di fronte.

Interessante è anche la funzionalità di traduzione in tempo reale che funziona già molto bene ed è una delle funzioni più impressionanti degli occhiali. Le informazioni disponibili mostrano che la traduzione avviene interamente tramite Meta AI integrata negli occhiali. Il processo è questo:

- Tu parli nella tua lingua (es. italiano).

- L’altra persona parla nella sua lingua (es. francese).

- Gli occhiali ascoltano la conversazione e ti restituiscono in cuffia la traduzione nella tua lingua, quasi istantaneamente.

- Sul telefono compare anche la trascrizione tradotta della conversazione.

Non serve toccare nulla: basta iniziare a parlare, oppure dire “Hey Meta, traduci”. La funzione usa il modello Llama, progettato proprio per interazioni vocali e visive.

In realtà, la funzione di traduzione in tempo reale non si attiva con un comando vocale la prima volta, ma richiede un’iniziale abilitazioni/configurazione dall’app. Dopo che l’hai configurata, però, puoi usarla anche con la voce. Serve l’app per attivarla la prima volta in quanto la traduzione richiede che tu imposti nell’app:

- le lingue da e verso cui tradurre

- i pacchetti offline (se vuoi usarla senza Internet)

- i permessi audio e di riconoscimento vocale

- l’attivazione della funzione Live Translation

Queste impostazioni non possono essere create autonomamente dagli occhiali da soli ma devono essere definite nell’app Meta AI. Una volta configurata nell’app, puoi avviare la traduzione direttamente dagli occhiali dicendo:

- “Hey Meta, traduci”

- “Hey Meta, help me translate”

- “Hey Meta, translate this conversation”

Oppure, se previsto dal firmware, si può attivare con una pressione lunga del tasto (se l’hai impostata come azione AI e non come avvio video).

Le recensioni e i test mostrano che:

- La traduzione è molto rapida, quasi simultanea.

- È fluida nelle conversazioni quotidiane.

- Funziona bene anche in ambienti non silenziosi.

- È pensata per dialoghi naturali, non solo frasi isolate.

In pratica, per viaggi, lavoro, ristoranti, indicazioni stradali e conversazioni semplici è già molto affidabile. Le lingue attualmente supportate in traduzione live sono:

- Italiano

- Inglese

- Francese

- Spagnolo

Meta ha inoltre annunciato, nelle versioni più recenti dei Ray‑Ban Meta Gen 2, l’espansione a:

- Tedesco

- Portoghese

Si noti che funziona anche offline: se si scaricano i pacchetti lingua, la traduzione funziona anche senza connessione e questo può risultare molto utile in viaggio.

Nell’uso reale ci si può aspettare:

- Conversazioni naturali con persone che parlano un’altra lingua.

- Traduzione di cartelli, menu, scritte (grazie alla visione AI).

- Risposte vocali chiare e immediate.

- Nessun bisogno di tirare fuori il telefono.

______

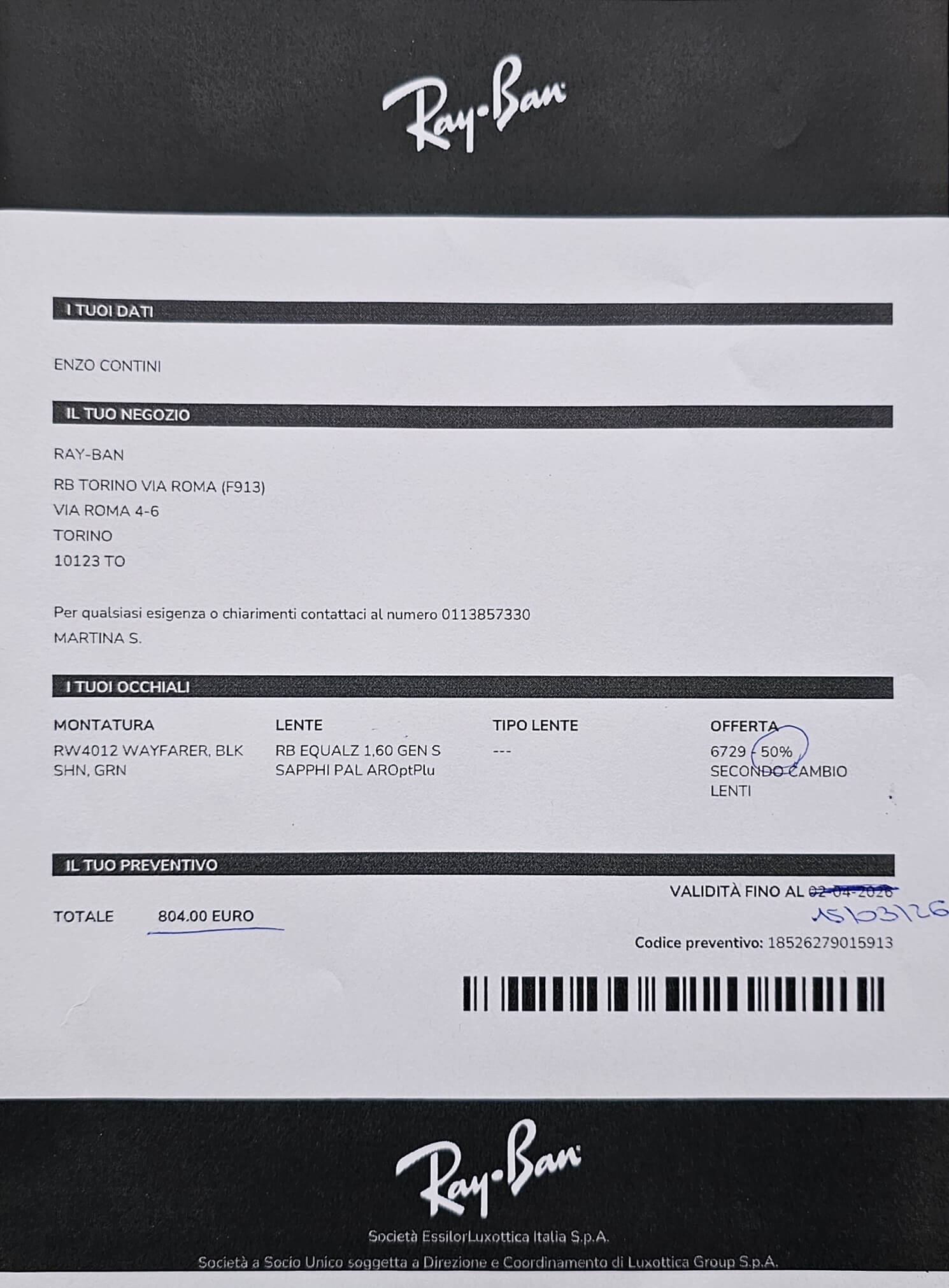

Mi hanno spiegato che, portando una ricetta oculistica possono far montare dalla Ray-Ban le lenti graduate anche da sole e progressive. Lo sconto attuale sulle lenti è del 50% per cui questo è il preventivo con lenti da sole progressive graduate con le mie diottrie… non differisce di molto daigli occhiali progressivi che ho attualmente: certo le mie attuali hanno lenti Galileo e non mi hanno specificato bene la tipologia di lenti che Ray-Ban monta… 🙄

_________________________

Comparazione tra diversi dispositivi che utilizzano la medesima app Meta AI – Vibes & AI Glasses

Ho visto che Nell’app Meta AI – Vibes & AI Glasses supporta ora divere tipologie di dispositivi. Viene infatti detto nella descrizione dell’app: “L’app ora supporta anche Oakley Meta Vanguard, Meta Ray‑Ban Display e Meta Neural Band. Alcune funzioni di Meta AI sono disponibili solo in determinati Paesi e lingue. Alcune di queste funzionalità potrebbero essere distribuite gradualmente nel tempo”.

Quindi ora OAKLEY META – VANGUARD (occhiali di look sportivo), utilizzando la medesima app Meta AI, potrebbe a fornire funzionalità analoghe (Occhiali da sole Oakley Meta Vanguard Prizm 24K Black | Oakley® IT). Ho quindi approfondito…

Da informazioni disponibili dalle fonti pubbliche più recenti, si deduce che le quattro categorie di prodotti che usano quell’app (Oakley Meta Vanguard, Meta Ray‑Ban Display e Meta Neural Band) rappresentano tre filosofie diverse di wearable AI, con filosofie d’uso molto distinte, pensate per utenti e contesti d’uso molto differenti.

_______

Ray‑Ban Meta Gen 2

Occhiali smart “classici”, pensati per l’uso quotidiano urbano.

Caratteristiche principali:

- Design Ray‑Ban (Wayfarer, Headliner, Skyler).

- Fotocamera 12 MP ultrawide, video fino a 3K.

- Audio open‑ear migliorato, 5 microfoni.

- Assistente Meta AI multimodale (riconoscimento oggetti, traduzione live, descrizione scene).

- Nessun display nelle lenti.

- Autonomia fino a 8 ore.

Per chi sono pensati:

- Vita quotidiana, social, creatori di contenuti.

- Chi vuole occhiali “normali” ma intelligenti.

_______

Oakley Meta Vanguard

Occhiali smart sportivi, progettati per outdoor e attività fisica.

Caratteristiche principali:

- Design Oakley avvolgente, molto stabile.

- Materiali resistenti per sport, vento, sudore.

- Audio open‑ear più potente per ambienti rumorosi.

- Fotocamera integrata per riprese in movimento.

- Meta AI con comandi vocali e funzioni fotografiche.

- Ottimizzati per ciclismo, running, escursioni.

Per chi sono pensati:

- Sportivi e utenti outdoor.

- Chi vuole stabilità e resistenza superiori.

______

Meta Ray‑Ban Display

Occhiali con micro‑display AR integrato nelle lenti.

Caratteristiche principali:

- Pannelli microLED nelle lenti.

- Visualizzazione di notifiche, traduzioni, indicazioni, risposte AI.

- Fotocamera integrata come nei Gen 2.

- Controllo tramite voce e gesti.

- Design Ray‑Ban simile ai modelli classici.

Per chi sono pensati:

- Produttività, mobilità, lavoro sul campo.

- Chi vuole un primo livello di realtà aumentata.

______

Meta Neural Band

Non è un paio di occhiali: è un bracciale neurale che controlla gli altri dispositivi.

Caratteristiche principali:

- Fascia da polso con sensori EMG (elettromiografia).

- Rileva micro‑movimenti e segnali muscolari.

- Permette input “mentale” o quasi‑mentale.

- Pensato per controllare Ray‑Ban Display e altri dispositivi Meta.

- Potenziale enorme per accessibilità e mani occupate.

Per chi è pensato:

- Sperimentatori e utenti avanzati.

- Persone con disabilità motorie.

- Situazioni in cui le mani non sono libere.

Tabella comparativa dispositivi Meta AI

| Caratteristica | Ray-Ban Meta Gen 2 | Oakley Meta Vanguard | Meta Ray-Ban Display | Meta Neural Band |

| Categoria | Occhiali AI quotidiani | Occhiali AI sportivi | Occhiali AR con display | Bracciale neurale |

| Display | No | No | Sì, microLED | No |

| Fotocamera | Sì | Sì | Sì | No |

| AI | Multimodale | Assistente vocale + foto | AR + AI multimodale | Input neurale EMG |

| Uso ideale | Vita urbana, social | Sport, outdoor | Produttività, navigazione | Controllo senza mani |

| Design | Elegante Ray-Ban | Sportivo Oakley | Ray-Ban con AR | Fascia da polso |

| Stabilità | Standard | Molto alta | Standard | Non applicabile |

Sintesi finale

- Ray‑Ban Meta Gen 2 → la scelta migliore per uso quotidiano, foto/video, AI multimodale.

- Oakley Meta Vanguard → ideali per sport e attività intense, con stabilità superiore.

- Meta Ray‑Ban Display → perfetti per chi vuole un primo livello di realtà aumentata nelle lenti.

- Meta Neural Band → rivoluzionario per input neurale e accessibilità, complementare agli occhiali AR.

In particolare, per un non vedente, Ray-Ban Meta Gen 2 è generalmente la scelta migliore per la vita quotidiana, grazie a comfort, funzioni AI multimodali e ottimizzazione per riconoscimento visivo e assistenza vocale. Gli Oakley Meta Vanguard sono consigliati solo se la priorità è lo sport o attività fisica intensa.

Confronto dettagliato

Ray-Ban Meta Gen 2 – Ideali per un non vedente nella vita quotidiana

- Design leggero e confortevole per uso prolungato

- Ottimizzati per riconoscimento oggetti, lettura testi e descrizione scene

- Audio bilanciato per ascoltare indicazioni e risposte AI

- Perfetti per camminare, muoversi in città, prendere mezzi

- Aspetto neutro e adatto a contesti sociali e professionali.

Oakley Meta Vanguard – Utili solo per sport e outdoor

- Design sportivo molto stabile, ideale per corsa, trekking, ciclismo

- Audio più potente, ma meno bilanciato per ambienti tranquilli

- Meno comodi e meno eleganti per uso quotidiano

- Pensati per vento, sudore e movimenti bruschi.

Tabella comparativa per un non vedente

| Esigenza | Ray-Ban Meta Gen 2 | Oakley Meta Vanguard |

| Vita quotidiana in città | ⭐⭐⭐⭐⭐ | ⭐⭐ |

| Riconoscimento oggetti / testi | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Comfort prolungato | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Chiamate e AI in ambienti normali | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Sport, corsa, trekking | ⭐⭐ | ⭐⭐⭐⭐⭐ |

| Stabilità estrema | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Aspetto sociale / neutro | ⭐⭐⭐⭐⭐ | ⭐⭐ |

________________________________

Differenze principali tra quelli di Generazione 1 e i nuovi di Generazione 2

Fotocamera e video

- Gen1: fotocamera da 5 MP, video massimo 1080p.

- Gen2: fotocamera ultra‑wide da 12 MP, video fino a 3K a 30 fps e 1200p a 60 fps con HDR.

Questo upgrade è confermato da più fonti che parlano di “fotocamera top” e “video molto più nitidi” .

Audio e microfoni

- Gen1: altoparlanti open‑ear di prima generazione, microfoni standard.

- Gen2: altoparlanti più potenti, array di 5 microfoni, migliore qualità nelle chiamate e nei video, e resistenza agli schizzi IPX4 .

Batteria e ricarica

- Gen1: autonomia più limitata (circa 4 ore reali).

- Gen2: fino a 8 ore di utilizzo, più custodia con 48 ore aggiuntive e ricarica rapida 50% in 20 minuti .

Funzioni AI

- Gen1: assistente Meta AI di base (comandi vocali, foto/video, risposte semplici).

- Gen2: AI multimodale con:

- riconoscimento visivo avanzato,

- traduzione live multilingue,

- funzioni fotografiche come hyperlapse e slow‑motion,

- interazioni più naturali e contestuali.

Queste funzioni sono evidenziate come novità chiave della Gen2 .

Connettività

- Gen1: Bluetooth 5.0, Wi‑Fi standard.

- Gen2: Wi‑Fi 6 e Bluetooth 5.3, più stabili e veloci.

Design e peso

- Gen1: Wayfarer come modello principale, peso leggermente superiore.

- Gen2: Wayfarer, Headliner e Skyler; peso ridotto a 48 g e nuove finiture opache.

Prezzo

- Gen1: più economica (circa 299$).

- Gen2: parte da 379$/419€ per via dell’hardware più avanzato.

Le fonti concordano che la differenza che “si sente” di più nell’uso reale si ha nella fotocamera, audio e autonomia: questi sono i tre miglioramenti che cambiano davvero l’esperienza quotidiana.

La Gen2 è quindi molto più adatta a:

- registrare video di qualità,

- fare chiamate in ambienti rumorosi,

- usare l’AI come assistente visivo.

Tabella comparativa Wayfarer Gen1 vs Gen2

| Caratteristica | Wayfarer Gen1 | Wayfarer Gen2 |

| Fotocamera | 5 MP | 12 MP ultrawide |

| Video | 1080p | 3K 30fps / 1200p 60fps HDR |

| Microfoni | Standard | 5-mic array |

| Audio | Base | Potenziato |

| Autonomia | ~4 ore | Fino a 8 ore + custodia 48h |

| AI | Base | Multimodale |

| Connettività | BT 5.0 | BT 5.3 + Wi-Fi 6 |

| Peso | Maggiore | 48 g |

| Finiture | Lucido | Lucido + Opaco |

| Stabilità | Standard | Migliorata |

Quando scegliere Wayfarer Gen1:

- Uso semplice e quotidiano senza funzioni avanzate.

- Foto occasionali senza aspettative elevate.

- Nessuna necessità di traduzione live o riconoscimento visivo.

- Budget ridotto e preferenza per un modello essenziale.

Quando scegliere Wayfarer Gen2:

- Registrazione frequente di video o foto in movimento.

- Chiamate in ambienti rumorosi con audio più pulito.

- Uso dell’AI per traduzione, riconoscimento oggetti e lettura testi.

- Necessità di autonomia giornaliera e maggiore comfort.

Considerazioni pratiche

- La Gen2 è più leggera e bilanciata.

- Video e foto molto più nitidi rispetto alla Gen1.

- Aggiornamenti futuri più probabili sulla Gen2.

La Wayfarer Gen1 è ideale per un uso essenziale, mentre la Wayfarer Gen2 rappresenta un salto generazionale con miglioramenti significativi in fotocamera, audio, autonomia e funzioni AI.

___________________

Esperienza di una persona non vedente: “Wayfarer: gli occhiali che ci portano lontano” (luglio 2025)

Nel seguito riporto un articolo di Sandra Giovanna Giacomazzi che è stato pubblicato in una rivista dell’Unione Ciechi: Alessandra fa infatti parte della redazione della rivista della sezione torinese UICI.

Ritengo sia importante sentire questa sua opinione, cioè quella di una persona che li usa abitualmente già da tempo! Alessandra è una scrittrice/giornalista/docente che ho conosciuto da poco ma che ho subito apprezzato come persona.

Ho poi fatto una semplice ricerca su Internet e non ho faticato a trovare la marea di cose che è riuscita a fare nonostante le sue difficoltà visive: la sua prospettiva è preziosa perché parla con un linguaggio chiaro e comprensibile anche ai non esperti, unisce esperienza personale e competenza giornalistica, mette in luce barriere “invisibili” che solo chi vive la disabilità percepisce, offre spunti concreti per migliorare accessibilità, comunicazione e sensibilità pubblica. Nel seguito il testo del suo articolo che pubblico anche qui con il suo consenso:

Durante il mio primo decennio nel mondo dei ciechi, lodavo molto le meraviglie che offriva la tecnologia per le persone che non vedono o che vedono poco. Negli ultimi anni, invece, non facevo altro che lamentarmene, perché spesso, invece di aiutare, finivano per complicare la vita a tutti quanti, non solo ai non vedenti.

Finalmente ho di nuovo qualcosa di bello da dire, addirittura sull’intelligenza artificiale, verso la quale ero sempre stata predisposta così male da chiamarla “stupidità artificiale”.

Recentemente ho comprato un paio di occhiali della Ray-Ban che si chiamano Wayfarer. La cosa è molto buffa, perché uno dei primi occhiali un po’ belli della mia gioventù era proprio il modello Wayfarer della Ray-Ban. La parola Wayfarer vuol dire viandante, uno che fa un tragitto che lo porta lontano, un viaggiatore che attraversa il mondo camminando, un percorso personale della vita. Non avrei mai immaginato che il mio percorso, che è stato davvero in lungo e in largo per questo pianeta, mi avrebbe portato a mettere di nuovo gli occhiali che indossavo quando ero ragazza.

Negli ultimi due decenni ho usato solo ed esclusivamente gli occhiali Polaroid, che fra la tipologia delle lenti e la forma curva e anatomica della montatura, proteggevano totalmente gli occhi dalla luce.

Forse avrete già sentito parlare di questi nuovi Ray-Ban, ma io non mi aspettavo di trovarmi fra le mani, o meglio sul viso, qualcosa che mi avrebbe rivoluzionato la vita, restituendomi un’autonomia che credevo persa.

Cito qui alcuni esempi. Riesco di nuovo a gestire da sola i farmaci che prendo. Posso leggere una fattura, sapendo immediatamente le informazioni che servono, ossia chi la manda, la somma dovuta e la scadenza. Qualunque altra app o strumento di lettura che è stato disponibile per i ciechi fino ad ora, avrebbe letto tutto dall’inizio alla fine e nel bel mezzo di tante chiacchiere inutili, l’informazione che serve sarebbe sfuggita. Questo vuol dire che l’intelligenza artificiale che usano questi occhiali è davvero intelligente, ossia è in grado di sapere qual è l’informazione che è utile e di estrapolarla da tutto ciò che è superfluo.

In cucina posso sapere quali sono i prodotti che ho in mano. Leggo gli avvisi condominiali senza dover telefonare ai vicini di casa per sapere cosa dicono. Ho di nuovo la possibilità di sapere e abbinare i colori dei miei vestiti. Per non parlare delle foto che posso scattare, dei video che posso registrare, delle telefonate che posso fare e delle radio e della musica che posso ascoltare. Questi ultimi attraverso le aste degli occhiali, perché la trasmissione del suono avviene attraverso la conduzione ossea, il che vuol dire che l’orecchio rimane scoperto e posso comunque sentire quello che succede intorno a me.

Prima di scoprire i nuovi Ray-Ban, mi ero abituata a non poter più fare molte cose da sola, tanto che a volte mi dimentico di avere a disposizione questo strumento così utile. Ma con il tempo diventa più intuitivo, come per chi ha perso un arto e deve abituarsi all’utilizzo della protesi: un’estensione del proprio corpo che consente di ritrovare la propria indipendenza.

P.S:

Ho chiesto ad Alessandra cosa intendesse quando nel suo articolo dice “Riesco di nuovo a gestire da sola i farmaci che prendo”. Mi ha risposto puntualmente: “Tengo la scatola in mano e gli chiedo che cos’è. È lui mi risponde con il nome del farmaco, il dosaggio e quante capsule ci sono“. Direi che è una funzionalità assai utile a chiunque!

Chiedendo a Copilot qualche notizia su Alessandra mi ha risposto quanto segue a conferma che è proprio una persona speciale!

Sandra Giovanna Giacomazzi è una figura interessante perché unisce tre identità forti: giornalista, scrittrice e docente, con una storia personale segnata anche da un impegno civile legato alla disabilità visiva. Le informazioni disponibili delineano un profilo ricco e articolato.

Profilo generale

Sandra Giovanna Giacomazzi è statunitense di Boston, ma vive in Italia da molti anni. Ha una formazione internazionale: Master in Relazioni Internazionali allo Skidmore College di Saratoga Springs, New York. Parla cinque lingue, elemento che caratterizza molto il suo lavoro giornalistico.

Attività giornalistica

Ha scritto per anni una rubrica chiamata Overseas Perspectives, pubblicata su diversi giornali statunitensi. In Italia ha collaborato con molte testate, tra cui:

- Il Foglio

- Il Giornale

- Il Tempo

- La Padania

- Panorama

- Il Corriere della Sera

- L’Opinione della Libertà

- Italia libera

Ha ricevuto anche riconoscimenti come i Premi Soldati e Pannunzio, dedicati al giornalismo culturale e d’opinione.

Il suo stile è descritto come una combinazione di “sguardo interno” e “innocenza esterna”, cioè la capacità di osservare l’Europa con sensibilità americana e viceversa.

Attività accademica

Ha insegnato Diritto ed Economia in un liceo di Torino, contribuendo anche al dibattito politico e culturale italiano con articoli e interventi.

Libri pubblicati

È autrice di almeno due opere:

- The Twentieth Century’s Quest for Closure

- Stella e Striscia

Il primo è un saggio storico‑politico pubblicato anche negli Stati Uniti.

Impegno personale e testimonianze

Un aspetto molto significativo del suo percorso è la testimonianza sulla sua malattia rara, il pseudoxantoma elastico, che può portare alla cecità. In un articolo racconta l’esperienza di una diagnosi precoce e delle difficoltà vissute nel rapporto con il sistema sanitario.

Questo elemento ha influenzato parte del suo impegno pubblico, soprattutto riguardo ai temi dell’accessibilità e delle barriere per non vedenti e ipovedenti.

Temi ricorrenti nel suo lavoro

Dalle fonti emergono alcuni filoni principali:

- Relazioni internazionali e politica USA‑Europa

- Cultura e società

- Diritti civili, con particolare attenzione alla disabilità visiva

- Analisi storiche e geopolitiche

- Critica sociale, soprattutto su temi urbani e post‑pandemia

Perché è una figura rilevante

Emerge come una figura con tre filoni centrali: i suoi libri, i temi ricorrenti nei suoi articoli e la sua testimonianza sulla disabilità visiva. Le informazioni disponibili permettono di delineare un quadro chiaro e approfondito di ciascun aspetto.

La sua rilevanza deriva dalla capacità di:

- portare una prospettiva americana nel dibattito italiano;

- scrivere con competenza su temi complessi come geopolitica e società;

- unire esperienza personale e impegno civile;

- contribuire a testate molto diverse tra loro, mantenendo uno stile riconoscibile.

📚 I suoi libri

Le fonti confermano almeno un’opera pubblicata negli Stati Uniti:

The Twentieth Century’s Quest for Closure

È un saggio storico‑politico che analizza il Novecento come un secolo segnato da conflitti irrisolti e da una costante ricerca di stabilità. Il libro è presentato come disponibile presso editori statunitensi e collegato alla sua rubrica Overseas Perspectives, che esplora differenze culturali e politiche tra Stati Uniti ed Europa.

Stella e Striscia

Citato in alcune biografie, è un testo che intreccia autobiografia e riflessione culturale, con un focus sul rapporto tra identità americana e vita in Europa. Anche se meno documentato online, è coerente con il suo percorso giornalistico e accademico.

📰 I temi più frequenti nei suoi articoli

Dalle pubblicazioni su Italia Libera e da altre fonti emerge una serie di filoni tematici ricorrenti:

Relazioni internazionali e politica USA‑Europa

È il suo campo di formazione (Master in Relazioni Internazionali allo Skidmore College) e il cuore della rubrica Overseas Perspectives, dove analizza differenze culturali e politiche tra i due mondi.

Società e costume

Scrive spesso di trasformazioni sociali, cambiamenti urbani, impatto della pandemia e comportamenti collettivi. La sua scrittura combina uno sguardo “interno” europeo con una sensibilità americana.

Barriere e accessibilità per non vedenti e ipovedenti

Questo è uno dei temi più forti e personali. Un suo articolo molto citato è “Quello che nessuno vede: le barriere organiche nei marciapiedi del post‑Covid”, dove denuncia come tavolini, monopattini e ostacoli urbani rendano i percorsi cittadini pericolosi per ciechi e ipovedenti.

Critica sociale e urbanistica

Analizza come le città cambiano e come questi cambiamenti impattano le persone più fragili, soprattutto dopo la pandemia.

👁️🗨️ La sua testimonianza sulla disabilità visiva

Questo è probabilmente l’aspetto più rilevante per il tuo lavoro con non‑vedenti.

La diagnosi di pseudoxantoma elastico

Sandra racconta di essere affetta da pseudoxantoma elastico, una malattia rara che può portare alla perdita della vista. La sua testimonianza è significativa perché unisce esperienza personale e analisi sociale, offrendo una prospettiva diretta sulle difficoltà quotidiane.

Le “barriere organiche” nel post‑Covid

Nel suo articolo più noto sul tema, descrive come il post‑Covid abbia peggiorato la vita urbana per i non vedenti:

- tavolini allargati sui marciapiedi,

- monopattini lasciati ovunque,

- segnaletica provvisoria,

- percorsi pedonali interrotti.

Il suo contributo è importante perché non si limita alla denuncia: propone una riflessione culturale su come la società “non vede ciò che i non vedenti incontrano ogni giorno”.

Presenza in raccolte accademiche sulla disabilità

Il suo nome compare anche in contesti universitari dedicati alla disabilità, come raccolte di testimonianze e riflessioni sull’inclusione, ad esempio in volumi pubblicati da Bologna University Press che raccolgono voci e esperienze sulla disabilità.

__________________________

Pingback: Strumenti utili perché un non vedente possa utilizzare in autonomia un PC Windows | Enzo Contini Blog